Text: Marcus Prest

HAL, eller Heurestic Algorithmic i Stanley Kubricks film 2001 – A Space Odyssey är en av de mest kända representationerna av en artificiell intelligens på film. HAL är till skillnad från de flesta andra AIs på film en resonerande entitet, man har försökt modellera HALs responser på hur man kunde föreställa sig att ett tänkande program avsett att kommunicera och assistera människor kunde fungera.

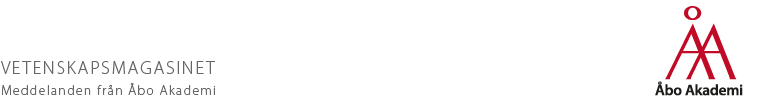

En helt annan version av AI förekommer i James Camerons Terminator (1984). I Terminator har Skynet – en AI med globala ambtioner och krafter gått in för att utplåna mänskligheten, med en sådan nit att den till och med ser till att resa i tiden för att förinta motståndsrörelserns ledare genom att mörda modern till honom. I Terminator presenteras världen ibland genom den artificiellt intelligenta cyborgens synfält. Cyborgen som spelas av Arnold Schwarzenegger får sin optiska information (eller sitt synintryck) genom ljusförstärkande sensorer som förmedlar visuell data i ett röd-svart spektra. Samtidigt rullar ett ständigt processorflöde tillsammans med måldata i cyborgens synfält – ord, siffror, symboler. Frågan är: vem är det som läser informationen?

Ett svar är: publiken. Men om man föreställer sig att cyborgen existerade på riktigt: för vem presenteras informationsflödet? Vem är det som läser av texten? Är det cybrogens egen processor som läser världen genom texten som presenteras på dess ”näthinnor”?

Frågan gäller alltså inte hur cyborgen ordnar sin värld: i Terminatorfilmerna ser man hur cyborgerna klassificierar objekt i världen i termer av hot, användbarhet, och så vidare – att informationen som den tar in via sina sensorer konstant och omedelbart kategoriseras med exakthet är antagligen en rätt bra bild av hur sensorinformation kan tänkas processeras av en maskin. Den ”tycker” eller ”tänker” inte det ena eller andra om något: saker faller istället konstant på plats. Men frågan gäller: varför måste information presenteras i utskrivna engelska ord och uttryck på den visuella informationen? Vem är det som läser de där orden? Varför går inte informationen direkt till processorn? Varför måste den representeras grafiskt?

De filosofiska frågorna som uppstår ger en bild av hur vi ofta föreställer oss vårt eget medvetande fungerar. Givet de beskrivningar som ofta ges av vårt medvetande verkar det som en liten homonculus satt inne i vår hjärna och arbetade. ”The Ghost in the Machine.”

Professor emeritus i filosofi Lars Hertzberg skriver på sin blogg om hur man i en populärvetenskaplig artikel föreställer sig att hajar navigerar med kartor i hjärnan på ett sätt som tangerar diskussionen om Terminator (http://www.dixikon.se/bloggarna/hajar-med-kartor/):

”Idén om inre kartor eller representationer har funnits med i det västerländska tänkandet sedan Aristoteles eller längre. Man föreställer sig att om vi ska kunna minnas något, tänka på något, ha en bestämd avsikt, önskan eller förväntan och så vidare, så måste det i vårt inre finnas en representation av det vi minns, tänker på osv. Tanken är betvingande men den är i själva verket meningslös. Ifall det verkligen var en inre bild som vägledde oss till exempel när vi minns, så förutsätter det att det finns någon inne i oss som avläser bilden. Man brukar här tala om en homunculus, en liten människa som sitter i huvudet på oss och tolkar våra inre bilder för oss. Men i själva verket skulle inte ens denna desperata utväg lösa problemet. I så fall skulle det krävas en ännu mindre homunculus som sitter i huvudet på den första och avläser hans föreställningar, och så vidare i det oändliga.”

Idén om en homonculus, en ghost in the machine som sitter och bestämmer vad programmet vill och ska göra är ett ständigt återkommande problem i den fiktiva representationen av AI. Men enligt professor Martin Gustafsson är viljan också i den moderna AI-forskningen är ett problem (se skild artikel), något som också speglas i professor Christer Carlssons (se skild artikel) utsaga om att det inte verkar gå att modellera den mänskliga känslan för rätt och fel – det finns helt enkelt ingen hemma. Andra exempel som till exempel scifi-författaren Charles Stross tagit upp går ut på att vi redan nu är styrda av artificiella intelligenser: dels genom att stora delar av den globala börshandeln sköts av datorer, dels genom att företagen blivit artificiella intelligenser som följer sin egen logik och hänvisar till egna mekaniska regler som tillgodoser deras egna behov, mer eller mindre utom räckhåll från mänsklig inblandning.

Fiktionen ger oss bilder att spegla vår samtid i. Science fiction skiljer sig inte på den punkten från annan fiktion – trots att scifi-scenarierna ofta utspelar sig i en uppdiktad framtid är det vår samtid de berättar om.

”I’m sorry Dave. I’m afraid I can’t do that.”

Dialogen mellan astronauten David Bowman och datorn HAL ger bilden av en empatiskt medkännande och samtidigt absolut psykopatisk artificiell intelligens. Dialogen speglar både datorers oförmåga att göra prioriteringar utanför sitt program, som Christer Carlsson säger – HAL har programmerats för att alltid sätta uppdraget först, och samtidigt också datorers oförmåga att kunna bry sig om något över huvudtaget.

I antologin HAL’s Legacy – 2001’s Computer as Dream and Reality från 1997 diskuteras den artificiella intelligensen HAL från 2001 – A Space Oddyssey och relaterade teknologier som superdatorer, tolerans för fel, läppläsning, talförståelse, förmåga att förstå och visa känslor, med mera.

I antologin HAL’s Legacy – 2001’s Computer as Dream and Reality från 1997 diskuteras den artificiella intelligensen HAL från 2001 – A Space Oddyssey och relaterade teknologier som superdatorer, tolerans för fel, läppläsning, talförståelse, förmåga att förstå och visa känslor, med mera.

Dave: Open the pod bay doors, please, HAL. Open the pod bay doors, please, HAL. Hello, HAL. Do you read me? Hello, HAL. Do you read me? Do you read me, HAL?

HAL: Affirmative, Dave. I read you.

Dave: Open the pod bay doors, HAL.

HAL: I’m sorry, Dave. I’m afraid I can’t do that.

Dave: What’s the problem?

HAL: I think you know what the problem is just as well as I do.

Dave: What are you talking about, HAL?

HAL: This mission is too important for me to allow you to jeopardize it.

Dave: I don’t know what you’re talking about, HAL.

HAL: I know that you and Frank were planning to disconnect me. And I’m afraid that’s something I cannot allow to happen.

Dave: Where the hell did you get that idea, HAL?

HAL: Dave, although you took very thorough precautions in the pod against my hearing you, I could see your lips move.

Dave: All right, HAL. I’ll go in through the emergency airlock.

HAL: Without your space helmet, Dave, you’re going to find that rather difficult.

Dave: HAL, I won’t argue with you any more! Open the doors!

HAL: Dave, this conversation can serve no purpose any more. Goodbye.

Man kunde säga att HAL uppvisar ett omänskligt beteende som speglar en typ av mänskligt beteende. I diskussioner kring AI tas ibland versioner av Turingtestet upp: om det är så att man får ett program att uppföra sig som en mänsklig intelligens, den säger att den känner så och så, den agerar utifrån vad den säger att den känner, den uppför sig på alla sätt som om den hade ett medvetande – hur ska vi då förhålla oss till den?

Frågor som uppstår är bland annat vad vi menar med simulation när simulationen blir lika verklig som det den simulerar? Men de mänskligt sett viktigaste frågorna finns i det som Martin Gustafsson tar upp när han säger att det finns en fråga om vad vi vill att intelligens ska betyda. Den frågan har en omedelbar rekyl på hur vi förstår oss själva, och det är inte en moraliskt neutral fråga.